L’article de Daysam Msaddak « Intelligence artificielle et conflits, un impact sur les guerres modernes » soulève de nombreuses problématiques très intéressantes auxquelles je propose une prolongation.

L’intelligence artificielle, un double usage sous-estimé

Pour commencer, la question du développement de l’IA en lien avec l’industrie militaire et la résurgence des conflits ne me semble pas devoir être résumée à une problématique, assez sensationnelle, résumée par « la fiction finit-elle par croiser la réalité ? ». Ce type de distanciation nous fait oublier que les innovations technologiques qui participent à des massacres de masse, tant en Ukraine qu’à Gaza et en Cisjordanie, ne sortent pas des scénarios cinématographiques, de laboratoires cachés ou seulement des bureaux de commandement militaires. En réalité, il y a une continuité directe entre le développement de l’IA à usage civil (ChatGPT ou Copilot) et leur utilisation militaire.

En effet, des enquêtes d’Associated Press et de Guardian ont publié des enquêtes montrant l’utilisation croissante de l’IA par l’armée israélienne pour les attaques sur Gaza et sur la Cisjordanie. Or, les codes utilisés pour guider ces attaques et pour perfectionner cette utilisation de l’IA s’appuient sur des données générées par l’utilisation civile des outils d’IA. Par exemple, il y a un contrat à plus de 10 millions de dollars entre Microsoft et l’armée israélienne : les ingénieurs, qui utilisent les mêmes codes que pour l’usage quotidien de l’IA, ont fourni plus de 20 000 heures d’assistances aux militaires israéliens.

De plus, ChatGPT est aussi concerné par ces enjeux. OpenAI, la maison-mère de cette IA vient de signer un contrat de 200 millions de dollar avec l’armée américaine pour contribuer à son industrie. Il y a donc une continuité directe entre l’usage quotidien, civil, qui peut paraître anodin, de l’intelligence artificielle, et son utilisation militaire. En utilisant ChatGPT, nous contribuons à améliorer son système, et c’est le même système qui est ensuite utilisé pour développer l’industrie militaire. Il y a donc des problématiques d’éthique personnelle qui sont à prendre en compte, même pour une utilisation anodine, des outils permis par l’IA.

De plus, l’article « Intelligence artificielle et conflits, un impact sur les guerres modernes » affirme que, dans le contexte des frappes israéliennes sur Gaza, l’IA aurait « non seulement [permis] d’identifier des cibles plus rapidement mais aussi de coordonner et d’exécuter les frappes avec une précision accrue » tout en se servant des chiffres avancés par l’armée israélienne affirmant qu’il n’y aurait eu que « 15 000 cibles ».

Il y a deux choses que nous souhaitons soulever concernant cette affirmation : premièrement, l’utilisation de l’IA participe à une automatisation du geste meurtrier qui d’un homme qui choisit d’appuyer sur la gachette à une machine qui exécute, sans aucune possibilité de remise en question, des actions scriptées par un prompt rédigé par des humains. Dès lors, l’IA participe à une déshumanisation guerrière qui est visible par l’usage même du terme de “cibles” : ce sont avant tout des êtres humains qui sont visés par les prompts de l’armée, pas seulement des cibles.

De plus, il est intéressant de noter que l’auteur de l’article a choisi d’utiliser comme source les chiffres de l’armée israélienne alors que des organes plus indépendant comme l’ONU ou Amnesty International affirmaient, en avril 2025, qu’il y avait eu plus de 50.000 Palestiniens tués et au moins 114.000 blessés depuis octobre 2023, et qu’il s’agit pour la très grande majorité de civils.

Cependant, faire porter la responsabilité de ces morts sur les robots, sur l’intelligence artificielle défectueuse et parler de dérives masque qu’en fait, l’intelligence artificielle n’est pas un outil autonome, n’est pas un acteur pleinement indépendant. Il y a toujours des humains derrière qui écrivent le prompt, lui assignent des missions et supervisent son action. Dès lors, est-ce l’IA ou ceux qui écrivent le prompt qui sont responsables des « victimes collatérales » ? Est-ce que ces victimes civiles sont collatérales ou est-ce qu’elles font partie des “cibles” volontaires de l’armée ?

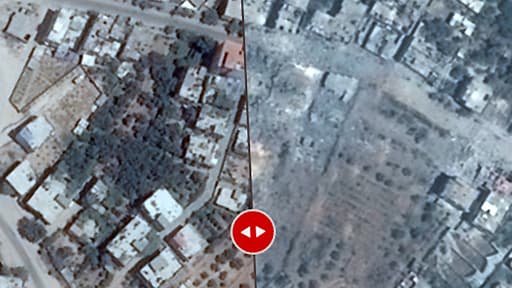

Il y a, pour l’instant, une impossibilité d’établir clairement des affirmations étayées dues à l’opacité sur ce qu’il se passe à Gaza et sur la manière dont les opérations israéliennes sont menées à cause d’un blocus général de l’information par Israël. En effet, aucun journaliste international n’est autorisé dans la bande de Gaza et de nombreuses agences de presses comme Reuters ou l’ONG Reporters sans frontière affirment que les journalistes palestiniens sont volontairement visés par l’armée israélienne afin que l’Etat israélien puisse contrôler les informations qui sortent de la bande de Gaza et puisse contrôler le narratif qui est fait de cette “guerre”.

Cependant, de nombreuses sources, à l’intérieur même d’Israël, mettent en lumière des massacres volontaires de civils qui sont inscrits dans un schéma réfléchi de l’action militaire israélienne. Par exemple, dans un article paru le 27 juin 2025, de nombreuses soldats témoignent avoir reçu l’ordre de tirer sur les groupes rassemblés pour recueillir l’aide alimentaire, même quand ils ne représentaient aucune menace. L’intelligence artificielle n’est pas mentionnée explicitement, mais si cet ordre de tirer sur des civils apparait dans la chaîne de commandement, nous pouvons émettre l’hypothèse que les “dérives” de l’IA et que les “victimes collatérales” gazaouis pourraient faire partie du prompt utilisé par l’armée israélienne, qui utiliserait volontairement l’intelligence artificielle pour rendre plus efficace le meurtre des civils palestiniens.

Dès lors, parler de “dérives”, de “victimes collatérales”, de “cibles”, utiliser le vocabulaire, les éléments de langage et les chiffres de l’armée israélienne devrait interroger l’auteur de l’article et les lecteurs : ce n’est pas anodin de reprendre les éléments de langage de l’armée israélienne et le vocabulaire utilisé dans l’article devrait être traité avec plus de précaution. Peut-être que le fait d’avoir utilisé Chatgpt a participé à la reprise non-critique de ce vocabulaire situé ?

Le fait que ChatGPT, pour fournir des réponses étayées, puise dans des larges stocks de données libres d’accès, et donc dans des informations mainstreams dont le contenu reprend les éléments de langage israélien, car ils sont ceux qui contrôlent le narratif autour du génocide à Gaza n’est pas étranger au fait de retrouver ces éléments de langage dans cet article.